Herzlich Willkommen auf meiner virtuellen Blogcouch, Ismail. Nimm bitte Platz und mach es Dir gemütlich. In der PLM-Community ist Dein Name als einer der prägenden Köpfe hinter dem SAP PLM Produktportfolio bekannt. Kannst Du trotzdem bitte ein paar Worte zu Deiner Person und Deinen beruflichen Stationen verlieren?

Herzlich Willkommen auf meiner virtuellen Blogcouch, Ismail. Nimm bitte Platz und mach es Dir gemütlich. In der PLM-Community ist Dein Name als einer der prägenden Köpfe hinter dem SAP PLM Produktportfolio bekannt. Kannst Du trotzdem bitte ein paar Worte zu Deiner Person und Deinen beruflichen Stationen verlieren?

Herzlichen Dank für die freundliche Einladung auf die virtuelle Blogcouch! Es ist mir eine Freude, hier Platz nehmen und mich über meine Erfahrungen und Einsichten im PLM austauschen zu dürfen.

Mein Name ist Ismail Serin und ich bin seit 2009 bei der SAP tätig. Während meiner Zeit bei SAP habe ich verschiedene Positionen im Bereich Produktentwicklung und -management bekleidet. Seit 2015 bin ich intensiv an der Transformation unseres PLM-Portfolios in die Cloud beteiligt, um unseren Kunden eine zukunftsfähige, skalierbare und flexible Lösung zur Verfügung zu stellen.

Lass mich hinzufügen, dass ein entscheidender Wendepunkt in meiner Karriere bei SAP die Akquisition von Fedem Technology, einem norwegischen Unternehmen, im Jahr 2015 war. Fedem war auf die Entwicklung von Softwarelösungen im Bereich Strukturanalyse und Simulation spezialisiert. Durch diese Akquisition wurde ich in den PLM-Bereich versetzt und begann, meine Expertise in diesem Gebiet zu vertiefen.

Die Integration von Fedems Technologien und Kompetenzen in das bestehende SAP PLM-Portfolio hat nicht nur dazu beigetragen, unsere Lösungen weiterzuentwickeln und zu verbessern, sondern auch mir persönlich ermöglicht, mein Wissen im Bereich PLM auszubauen und eine wichtige Rolle bei der Gestaltung unserer Produktstrategie zu übernehmen.

Seitdem arbeite ich eng mit Kunden, Partnern und Kollegen zusammen, um die bestmöglichen PLM-Lösungen zu entwickeln und erfolgreich am Markt zu etablieren. Dabei liegt mein Fokus insbesondere auf der Integration neuer Technologien, um Unternehmen dabei zu unterstützen, ihre Produktentwicklungsprozesse zu optimieren und den Herausforderungen der digitalen Transformation erfolgreich zu begegnen.

Ich freue mich darauf, meine Erkenntnisse und Erfahrungen mitzuteilen und spannende Diskussionen rund um das Thema PLM zu führen.

Als Cloud-Befürworter im PLM-Geschäft begleitet Ihr als ein führender Lösungsanbieter Unternehmen auf Ihrem Weg in die Digitalisierung und löst Herausforderungen aus den Wertschöpfungsprozessen. Blicken wir einmal 10 Jahre zurück. Was unterscheiden die heutigen Softwarelösungen von denen der damaligen Zeit?

Wenn wir 10 Jahre zurückblicken, sind die Unterschiede zwischen den damaligen und heutigen Softwarelösungen im PLM-Bereich enorm. Die wichtigsten Veränderungen betreffen die Bereiche Digitalisierung, Vernetzung und Skalierbarkeit.

Digitalisierung

Digitalisierung im PLM hat weitreichende Auswirkungen auf die Art und Weise, wie Unternehmen ihre Produktlebenszyklusdaten verwalten und nutzen. Ein zentrales Konzept, das mit der Digitalisierung einhergeht, ist der Digital Thread. Dieses Konzept spielt eine entscheidende Rolle bei der Verbesserung von Effizienz und Entscheidungsfindung in Unternehmen. Es bezieht sich auf die digitale Verknüpfung und den Informationsfluss zwischen allen Phasen des Produktlebenszyklus – von der Ideenfindung und Konzeption über die Entwicklung, Produktion, Wartung bis hin zur Entsorgung.

- Konsistenz und Nachverfolgbarkeit: Da alle Informationen und Daten im Digital Thread miteinander verknüpft sind, ist es einfacher, Änderungen und Anpassungen im Produktlebenszyklus nachzuvollziehen. Dies führt zu einer besseren Datenkonsistenz und ermöglicht eine lückenlose Rückverfolgung von Produktänderungen und deren Auswirkungen.

- Schnellere Markteinführung: Durch die nahtlose Integration und den Informationsfluss im Digital Thread können Unternehmen ihre Produktentwicklung beschleunigen und Produkte schneller auf den Markt bringen. Zeitraubende manuelle Prozesse und Abstimmungen zwischen verschiedenen Abteilungen werden minimiert, was die Effizienz erhöht.

- Innovation: Durch die Integration von Daten und Informationen aus verschiedenen Bereichen des Produktlebenszyklus kann der Digital Thread dazu beitragen, Verbesserungspotenziale und Innovationen aufzudecken. Unternehmen können auf Basis dieser Erkenntnisse ihre Prozesse und Produkte optimieren und wettbewerbsfähiger werden.

Vernetzung

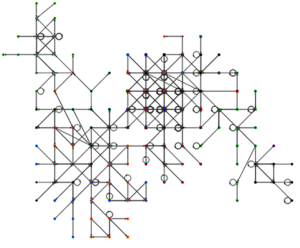

Die Vernetzung ist ein weiterer wichtiger Aspekt im Zusammenhang mit der Digitalisierung im PLM. Sie bezieht sich auf die Verbindung und Kommunikation zwischen verschiedenen Abteilungen, Prozessen, Systemen und sogar Unternehmen, die an der Entwicklung und Verwaltung eines Produkts beteiligt sind. Die Vernetzung im PLM hat in den letzten Jahren stark zugenommen, insbesondere durch den Einsatz von Cloud-Technologien und modernen Kommunikationslösungen.

Die Vernetzung ist ein weiterer wichtiger Aspekt im Zusammenhang mit der Digitalisierung im PLM. Sie bezieht sich auf die Verbindung und Kommunikation zwischen verschiedenen Abteilungen, Prozessen, Systemen und sogar Unternehmen, die an der Entwicklung und Verwaltung eines Produkts beteiligt sind. Die Vernetzung im PLM hat in den letzten Jahren stark zugenommen, insbesondere durch den Einsatz von Cloud-Technologien und modernen Kommunikationslösungen.

- Verbesserte Zusammenarbeit: Eine stärkere Vernetzung ermöglicht eine bessere Zusammenarbeit zwischen den verschiedenen Akteuren im Produktlebenszyklus. Sie fördert den Informationsaustausch und ermöglicht es Teams und Abteilungen, effizienter zusammenzuarbeiten und ihre Expertise zu bündeln.

- Integration von Lieferketten und Partnern: Die Vernetzung erlaubt es Unternehmen, ihre Lieferketten und externen Partner effizienter in den PLM-Prozess einzubinden. Dies fördert die Zusammenarbeit und den Informationsaustausch mit Zulieferern, Dienstleistern und Kunden und trägt dazu bei, die gesamte Wertschöpfungskette zu optimieren.

- Kürzere Entwicklungszyklen: Durch die Vernetzung von Prozessen und Systemen im PLM können Unternehmen ihre Produktentwicklung beschleunigen. Die Kommunikation zwischen den verschiedenen Entwicklungsphasen wird verbessert, was zu einer schnelleren Markteinführung von Produkten führt.

Skalierbarkeit

- Kosteneffizienz: Die Skalierbarkeit durch die Cloud ermöglicht es Unternehmen, ihre IT-Kosten besser zu kontrollieren. Da Ressourcen bei Bedarf hinzugefügt oder reduziert werden können, entfallen teure Investitionen in die eigene IT-Infrastruktur und Wartung. Unternehmen zahlen in der Regel nur für die Ressourcen, die sie tatsächlich nutzen.

- Schnelle Implementierung und Aktualisierung: Cloud-basierte PLM-Lösungen können in der Regel schneller implementiert und aktualisiert werden als lokal installierte Systeme. Dies ermöglicht es Unternehmen, neue Funktionen und Verbesserungen schneller zu nutzen und ihre PLM-Prozesse kontinuierlich zu optimieren.

- Globale Verfügbarkeit und Zusammenarbeit: Da Cloud-basierte PLM-Systeme über das Internet zugänglich sind, können Mitarbeiter und Partner von überall auf der Welt auf die Daten und Informationen zugreifen. Dies fördert die Zusammenarbeit und den Informationsaustausch zwischen verschiedenen Standorten und Abteilungen.

Der Blick in die Zukunft ist immer etwas schwierig, aber lass es uns doch einmal versuchen. Welche Dinge werden uns im PLM in den nächsten Jahren weiter massiv beschäftigen?

Künstliche Intelligenz und Process Analytics werden zweifellos eine entscheidende Rolle bei der zukünftigen Entwicklung im PLM in den nächsten 10 Jahren spielen. Diese Technologien haben das Potenzial, die Art und Weise, wie Unternehmen ihre Produktentwicklung und -verwaltung angehen, grundlegend zu verändern und zu verbessern.

KI im PLM: Künstliche Intelligenz kann in verschiedenen Phasen des Produktlebenszyklus eingesetzt werden, um den Entscheidungsprozess zu unterstützen, die Effizienz zu erhöhen und innovative Lösungen zu entwickeln. Einige mögliche Anwendungsbereiche von KI im PLM umfassen:

- Automatisierung von Routineaufgaben: KI kann dazu beitragen, manuelle und zeitaufwändige Prozesse zu automatisieren, indem sie Muster erkennt und Aufgaben schneller und präziser ausführt als menschliche Mitarbeiter. Dadurch können Unternehmen Ressourcen einsparen und ihre Effizienz steigern.

- Optimierung von Produktentwicklung und -design: KI kann große Mengen an Daten analysieren und Muster erkennen, um bessere Produktkonzepte und -designs zu entwickeln. Dies kann dazu beitragen, die Produktqualität zu verbessern und die Entwicklungszeit zu verkürzen.

- Vorhersage von Produktfehlern und Wartungsbedarf: KI kann dazu verwendet werden, potenzielle Produktfehler und Wartungsanforderungen vorherzusagen, indem sie historische Daten und Sensordaten aus dem Feld analysiert. Dies ermöglicht es Unternehmen, proaktiv zu handeln und kostspielige Ausfälle oder Rückrufe zu vermeiden.

Process Analytics im PLM: Process Analytics bezieht sich auf die Analyse und Optimierung von Geschäftsprozessen. Durch den Einsatz von Process Analytics können Unternehmen:

- Transparenz und Kontrolle über ihre Prozesse gewinnen: Process Analytics ermöglicht es Unternehmen, ihre PLM-Prozesse zu visualisieren und zu analysieren, um Engpässe, Ineffizienzen und Verbesserungspotenziale zu identifizieren.

- Datenbasierte Entscheidungen treffen: Durch die Analyse von Prozessdaten können Unternehmen fundierte Entscheidungen treffen, die auf Fakten und Erkenntnissen basieren, anstatt auf Intuition oder Erfahrung.

- Prozessleistung kontinuierlich verbessern: Process Analytics kann dazu beitragen, die Leistung von PLM-Prozessen kontinuierlich zu überwachen und zu optimieren, um die Effizienz, Qualität und Geschwindigkeit der Produktentwicklung und -verwaltung zu steigern.

Und wenn wir auf die Wertschöpfungsprozesse blicken, wo siehst Du die größten Unterschiede und Entwicklungen in den vergangenen Jahren? Was machen Unternehmen heute in Ihren Geschäftsprozessen anders und besser?

In den vergangenen Jahren haben sich die Wertschöpfungsprozesse in Unternehmen aufgrund technologischer Fortschritte und sich verändernder Marktbedingungen erheblich weiterentwickelt. Angesichts des schnellen Wandels in vielen Branchen haben Unternehmen begonnen, agilere und flexiblere Entwicklungsprozesse einzuführen. Sie sind in der Lage, schnell auf Marktveränderungen oder Kundenanforderungen zu reagieren und ihre Ressourcen effizienter einzusetzen. Viele Unternehmen setzen verstärkt auf digitale Technologien, um ihre Prozesse zu automatisieren und effizienter zu gestalten. Dadurch können sie ihre Produktivität steigern, Kosten reduzieren und die Qualität ihrer Produkte zu verbessern. Darüber hinaus gibt es einen wachsenden Fokus auf Nachhaltigkeit und Kreislaufwirtschaft in der Wertschöpfung. Unternehmen integrieren ökologische und soziale Aspekte in ihre Prozesse, um Ressourceneffizienz zu verbessern, Abfall zu reduzieren und ihren ökologischen Fußabdruck zu minimieren.

Als weltweit führender Anbieter für Unternehmenssoftware seid ihr untrennbarer Teil dieses Transformationsprozesses in den Unternehmen. Welche Herausforderungen bewegen Unternehmen in diesen Zeiten?

Einige der wichtigsten Herausforderungen, denen Unternehmen derzeit gegenüberstehen, sind:

- Nachhaltigkeit und soziale Verantwortung: Unternehmen sind zunehmend gefordert, ihre soziale und ökologische Verantwortung wahrzunehmen und nachhaltige Praktiken in ihre Geschäftsprozesse zu integrieren. Dies erfordert eine Neuausrichtung der Wertschöpfungsketten, Investitionen in umweltfreundliche Technologien und die Einbindung von Stakeholdern.

- Anpassung an die digitale Transformation: Unternehmen müssen sich an die sich schnell entwickelnde digitale Landschaft anpassen und digitale Technologien in ihre Geschäftsprozesse integrieren. Dies erfordert eine kontinuierliche Weiterbildung der Mitarbeiter, die Anpassung der Organisationsstrukturen und die Implementierung neuer Technologien und Systeme.

- Datensicherheit und Datenschutz: Mit der zunehmenden Menge an verfügbaren Daten und der wachsenden Vernetzung von Systemen steigt auch das Risiko von Cyberangriffen und Datenschutzverletzungen. Unternehmen müssen sich darauf konzentrieren, ihre Daten und Systeme sicher zu halten und die Einhaltung von Datenschutzbestimmungen sicherzustellen.

- Talentmanagement und Fachkräftemangel: Die digitale Transformation erfordert spezialisierte Kenntnisse und Fähigkeiten, die möglicherweise in vielen Unternehmen fehlen. Unternehmen müssen Strategien entwickeln, um qualifizierte Mitarbeiter zu gewinnen, zu halten und weiterzubilden, um den Bedarf an digitalen Kompetenzen zu decken.

- Wettbewerbsdruck und Globalisierung: Unternehmen stehen unter immer größerem Druck, ihre Produkte und Dienstleistungen kontinuierlich zu verbessern und sich von der Konkurrenz abzuheben. Die Globalisierung eröffnet neue Märkte, erhöht aber auch den Wettbewerb und stellt Unternehmen vor zusätzliche Herausforderungen.

Als Teil des Transformationsprozesses in Unternehmen ist es unsere Aufgabe als führender Anbieter von Unternehmenssoftware, innovative Lösungen bereitzustellen, die Unternehmen dabei unterstützen, diese Herausforderungen erfolgreich zu bewältigen. Dazu zählen die Bereitstellung von Softwarelösungen zur Prozessoptimierung, Sicherheit, Zusammenarbeit und Datenanalyse sowie die Förderung von Wissenstransfer und Best Practices.

Und Herausforderungen verlangen natürlich nach Lösungen und dabei spielt gerade PLM eine herausragende Rolle. Welche PLM-Lösungen bietet Ihr denn an und wie hilft eure Software Industrieunternehmen durch diese bewegten Zeiten?

Als Anbieter von PLM-Lösungen bieten wir eine Reihe von Cloud Services an, die speziell entwickelt wurden, um Industrieunternehmen sowohl in der Diskreten- als auch in der Prozessindustrie bei der Bewältigung der Herausforderungen der digitalen Transformation zu unterstützen. Unsere PLM-Lösungen umfassen folgende Aspekte:

- Zentrale Datenverwaltung: Unsere PLM-Software ermöglicht es Unternehmen, sämtliche Produktinformationen zentral zu verwalten und auf einer einheitlichen Plattform bereitzustellen. Dies schafft eine Single Source of Truth für alle Beteiligten, erleichtert den Informationsaustausch und verbessert die Zusammenarbeit innerhalb des Unternehmens sowie mit externen Partnern.

- Prozessautomatisierung und -optimierung: Unsere Lösungen unterstützen Unternehmen bei der Automatisierung und Optimierung ihrer Produktentwicklungsprozesse, um Effizienz und Produktivität zu steigern. Durch die geplante integration von KI und maschinellem Lernen können komplexe Aufgaben schneller und genauer erledigt werden, was zu einer beschleunigten Markteinführung und Kosteneinsparungen führt.

- Nachhaltigkeits- und Kreislaufwirtschaftsanalyse: Unsere Software bietet Funktionen zur Bewertung der Umweltauswirkungen von Produkten und Prozessen sowie zur Identifizierung von Möglichkeiten zur Verbesserung der Ressourceneffizienz und Reduzierung von Abfällen.

- Projekt- und Ressourcenmanagement: Unsere L√∂sungen bieten umfassende Funktionen für das Projekt- und Ressourcenmanagement, die es Unternehmen ermöglichen, ihre Projekte effizient zu planen, steuern und überwachen. Dies hilft dabei, Engpässe und Risiken frühzeitig zu erkennen und sicherzustellen, dass Ressourcen optimal eingesetzt werden.

- Integration von CAD Systemen: Unsere PLM-Software ermöglicht die nahtlose Integration von CAD Systemen, um den gesamten Entwicklungsprozess von der Konzeption bis zur Fertigung zu unterstützen. Dies fördert die Zusammenarbeit zwischen den verschiedenen Abteilungen und hilft, Entwicklungszeit und -kosten zu reduzieren.

- Konfigurations- und Änderungsmanagement: Mit unserer PLM-Software können Unternehmen den gesamten Änderungsprozess von Produktkonfigurationen verwalten und nachverfolgen. Dies stellt sicher, dass alle Beteiligten √ºber die aktuellsten Informationen verfolgen und Änderungen effizient und nachvollziehbar umgesetzt werden.

- Compliance und Qualitätsmanagement: Unsere PLM-Lösungen unterstützen Unternehmen bei der Einhaltung von Industrienormen, gesetzlichen Vorschriften und Qualitätsstandards. Sie ermöglichen eine systematische Erfassung und Überwachung von Qualitäts- und Compliance-Anforderungen während des gesamten Produktlebenszyklus.

Durch die Bereitstellung dieser umfassenden PLM-Lösungen unterstützen wir Industrieunternehmen dabei, die Herausforderungen der digitalen Transformation erfolgreich zu meistern. Unsere Software hilft ihnen, ihre Prozesse zu optimieren, die Zusammenarbeit zu fördern, die Markteinführung zu beschleunigen

Ich danke Dir sehr für dieses Gespräch und wünsche für die Weiterentwicklung des Produktportfolios alles erdenklich Gute und viel Erfolg.

Eine der vielversprechendsten Ansätze, die diesen Produktentwicklungsprozess revolutioniert, ist die Integration von Knowledge Graphs mit Generative AI (GenAI). Diese Kombination ermöglicht es, komplexe Zusammenhänge zu verstehen und fundierte Entscheidungen zu treffen. Doch wie genau funktioniert das? Und welche konkreten Vorteile bringt es in der Praxis?

Eine der vielversprechendsten Ansätze, die diesen Produktentwicklungsprozess revolutioniert, ist die Integration von Knowledge Graphs mit Generative AI (GenAI). Diese Kombination ermöglicht es, komplexe Zusammenhänge zu verstehen und fundierte Entscheidungen zu treffen. Doch wie genau funktioniert das? Und welche konkreten Vorteile bringt es in der Praxis? Der Knowledge Graph enthält Daten über Ressourcen, frühere Projektzeitpläne und Zulieferer. Das LLM kann diese Informationen analysieren und so einen optimalen Projektplan erstellen. Dabei werden mögliche Engpässe identifiziert und Alternativen und Lösungen unter Berücksichtigung der Projekthistorie und aktuellen regulatorische Anforderungen vorgeschlagen. Auch die Auswahl geeigneter Zulieferer und Partner für klinische Studien wird durch das System unterstützt, indem es auf vergangene Leistungsdaten und aktuelle Marktanalysen zugreift.

Der Knowledge Graph enthält Daten über Ressourcen, frühere Projektzeitpläne und Zulieferer. Das LLM kann diese Informationen analysieren und so einen optimalen Projektplan erstellen. Dabei werden mögliche Engpässe identifiziert und Alternativen und Lösungen unter Berücksichtigung der Projekthistorie und aktuellen regulatorische Anforderungen vorgeschlagen. Auch die Auswahl geeigneter Zulieferer und Partner für klinische Studien wird durch das System unterstützt, indem es auf vergangene Leistungsdaten und aktuelle Marktanalysen zugreift.

Die Vernetzung ist ein weiterer wichtiger Aspekt im Zusammenhang mit der Digitalisierung im PLM. Sie bezieht sich auf die Verbindung und Kommunikation zwischen verschiedenen Abteilungen, Prozessen, Systemen und sogar Unternehmen, die an der Entwicklung und Verwaltung eines Produkts beteiligt sind. Die Vernetzung im PLM hat in den letzten Jahren stark zugenommen, insbesondere durch den Einsatz von Cloud-Technologien und modernen Kommunikationslösungen.

Die Vernetzung ist ein weiterer wichtiger Aspekt im Zusammenhang mit der Digitalisierung im PLM. Sie bezieht sich auf die Verbindung und Kommunikation zwischen verschiedenen Abteilungen, Prozessen, Systemen und sogar Unternehmen, die an der Entwicklung und Verwaltung eines Produkts beteiligt sind. Die Vernetzung im PLM hat in den letzten Jahren stark zugenommen, insbesondere durch den Einsatz von Cloud-Technologien und modernen Kommunikationslösungen.